Как построить LLM? определение, варианты использования и шаги

- АИ/МЛ

- 24 октября 2025 г.

Разрабатывая решение для ИИ корпоративного уровня и необходимо сделать его более быстрым? Давайте выберем готовые к интеграции LLM общего назначения! Но подождите, готовы ли вы решать проблемы, создаваемые общими LLM, такие как галлюцинации, логические сбои в рассуждениях, уязвимости безопасности данных и конфиденциальности, устаревшие или обобщенные знания и т. Д.? Готовые к интеграции LLM, такие как ChatGPT, могут показаться экономически эффективными и экономящими время, но они несут последствия затрат в будущем.

В таких случаях разработка собственной модели большого языка (LLM) может предложить значительные преимущества.

обычай Услуги LLM по развитию позволяют использовать собственные наборы данных, тонкую настройку выходов для конкретных вариантов использования и предоставление решений ИИ, которые являются точными и согласованными с бизнес-целями.

Будь то автоматизация поддержки клиентов, генерация информации из сложных документов или улучшение внутреннего управления знаниями, хорошо построенный LLM может трансформировать операции и принятие решений.

В этом руководстве разбивается все, что вам нужно знать о том, как разрабатывать LLM, от понимания различных типов и их бизнес-приложений до пошагового процесса. К концу у вас будет четкая дорожная карта для внедрения готового к работе ИИ, который приносит ощутимую ценность.

Ключевые выносы

- Готовые модели являются мощными, но LLM может обеспечить более точную, контекстно-ориентированную и совместимую работу. ИИ-решения адаптированы к вашему бизнесу.

- Чтобы создать свой собственный LLM, вы должны начать с определения варианта использования, аудитории и показателя успеха в рамках своей стратегической основы.

- Чем умнее данные, тем умнее LLM, поэтому чистые, курируемые и хорошо структурированные наборы данных не подлежат обсуждению.

- Точная настройка обычно является самым быстрым способом повышения производительности LLM.

- Непрерывная обратная связь с человеком имеет решающее значение для обучения LLM для точности, безопасности и актуальности.

Итак, вы заинтересованы в создании собственного LLM, который обучается на ваших наборах данных и обеспечивает результаты, как вы хотите? Наймите разработчиков AI Из MindInventory!

Что такое LLM?

LLM расшифровывается как Large Language Models, тип искусственного интеллекта, который использует Модели AI/ML По своей сути LLM - это нейронная сеть, часто основанная на архитектуре Трансформера, которая изучает шаблоны, контекст и отношения в тексте.

Таким образом, можно сказать, что LLM может выступать в качестве масштабируемого работника знаний, автоматизируя повторяющиеся задачи, улучшая скорость принятия решений и предоставляя информацию из огромного количества неструктурированного текста.

В качестве примеров LLM можно привести GPT-4 от OpenAI, Gemini от Google DeepMind, Claude 3 от Anthropic, LLaMA 3 от Meta и Mistral 7B от Mistral AI.

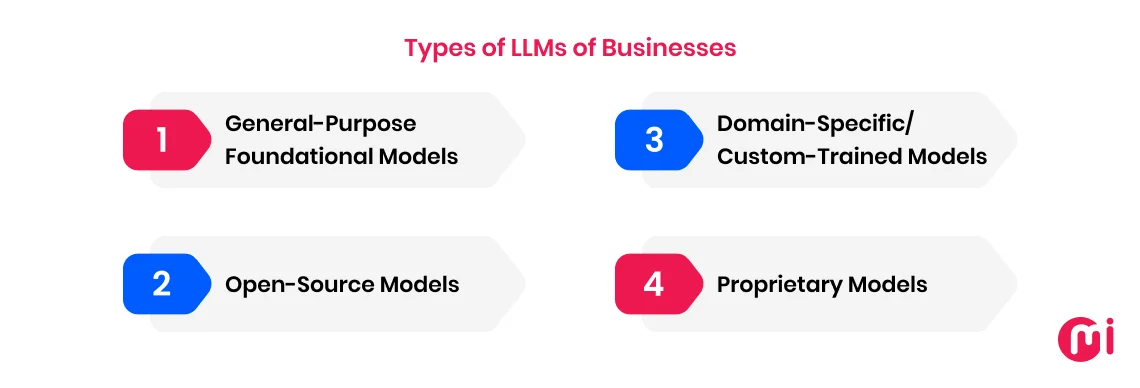

Виды LLM-бизнеса могут быть построены

Большие языковые модели (LLM) классифицируются по архитектуре, учебным данным и целям, а также модальностям, если они следуют академическим ценностям. Основные типы LLM включают только декодер, только кодер, кодер-декодер и мультимодальные модели, каждая из которых предназначена для конкретных задач и приложений обработки естественного языка.

Если вы бизнес, ищущий практические типы LLM, то вы должны рассмотреть общие, открытые исходные коды, доменные или проприетарные модели.

Давайте рассмотрим практические типы LLM-бизнеса, о которых следует знать:

1.Основные модели общего назначения

Это большие, предварительно обученные базовые модели, предназначенные для решения самых разных задач без необходимости перестраиваться с нуля. Они составляют основу многих Приложения AI/ML Обеспечивая универсальные возможности рассуждения, понимания и генерации текста.

Примеры: Близнецы, GPT, Клод и PaLM.

2. Модели с открытым исходным кодом

Эти модели являются общедоступными, что позволяет Разработчики ML и организаций для проверки, модификации и переподготовки их для конкретных нужд, часто по более низкой цене. Они часто являются более мелкими или поддерживаемыми сообществом вариантами коммерческих LLM, но поощряют инновации и прозрачность.

Примеры: LLaMA 3, Mistral 7B, Falcon и RedPajama.

3. Модели, ориентированные на конкретные области/навыки

Этот тип LLM обучается на специализированных наборах данных для конкретной отрасли, таких как здравоохранение, финансы, юриспруденция и т. Д. Они обеспечивают более высокую точность в нишевых контекстах, где отраслевая терминология и соответствие жизненно важны. Следовательно, они полезны для задач, требующих специализированных знаний, формулировки соответствия или глубокого понимания конкретной области.

Примеры: BloombergGPT (финансы), Med-PaLM 2 (здравоохранение) и LegalBERT (юридическое дело).

4.Собственные модели

Как следует из названия, эти модели разрабатываются и принадлежат конкретным компаниям. Собственные модели LLM предлагаются в качестве услуг с закрытым исходным кодом, которые доступны в основном через API. Они обучаются на частных, часто курируемых наборах данных и настраиваются на высокую точность и соответствие отраслевым стандартам.

Эти модели обеспечивают современную производительность, надежную поддержку корпоративного уровня, регулярные обновления и бесшовную интеграцию в существующие бизнес-системы, что делает их идеальными для организаций, ориентированных на стабильность и простоту развертывания.

Примеры: Клод 3.5 Sonnet и Близнецы 1.5 Pro.

Почему общие LLM-системы не работают в корпоративной среде

Общие модели больших языков (LLM) не подходят для корпоративных сред, в первую очередь из-за ограничений в решении сложных, крупномасштабных и специфических для конкретных областей задач, которые требуются предприятиям.

Помимо этого, основные причины включают в себя:

- Ограничение в обработке объема текста за раз.

- Отсутствие понимания уникальных данных, терминологии и процессов компании.

- Не имея важных функций, таких как быстрое управление, контроль доступа и изоляция данных, они должны соответствовать требованиям безопасности корпоративного уровня.

- Природа «черного ящика» не позволяет им обеспечивать соответствие, отслеживать решения или проверять точность результатов.

- Неспособность надежно взаимодействовать с несколькими корпоративными системами для выполнения задач.

- Отсутствие структурированных рассуждений для выполнения точных бизнес-процессов.

- Склонность к генерации неточного или «галлюцинированного» контента.

- Слабый контроль конфиденциальности и осведомленность о соблюдении.

- Производительность может быть непоследовательной и не иметь стабильности, предсказуемости и контроля версий.

Почему вы должны построить свой собственный LLM?

Вы должны создать свой собственный LLM для более полного контроля над безопасностью данных, настройкой модели и производительностью для конкретных потребностей.

Некоторые из основных причин для создания собственного LLM включают:

- Гарантия доверия, этическая согласованность и контроль предвзятости, гарантируя, что ваша модель работает в рамках этических, правовых и нормативных границ вашей организации.

- Безопасность данных и управление конфиденциальностью, поскольку ваша собственная модель не будет полагаться на внешние серверы, снижая риск утечки данных и обеспечивая соблюдение требований.

- Настройка и контроль специфичности позволяют обучать LLM с помощью собственных данных, что приводит к более точным и релевантным выводам для нишевых вариантов использования.

- Полный контроль и независимость, позволяющие вам привести LLM в соответствие с вашими конкретными требованиями и бизнес-целями (покрытие архитектуры модели, данные обучения и обновления).

- Конкурентное преимущество, поскольку вы сможете создавать уникальные услуги, продукты или опыт клиентов, отличая вас от конкурентов.

- Потенциальная экономия средств в масштабе и в долгосрочной перспективе, если у вас есть большой объем запросов на вывод.

- Объяснение является еще одним ключевым фактором для создания собственного LLM, поскольку оно помогает поддерживать сквозную прозрачность и контроль, повышать надежность в доменах с высокими ставками и обеспечивать конфиденциальность данных и соблюдение требований.

Стоит ли тренировать свой LLM или использовать уже существующий?

Вы должны использовать существующий LLM, если вам нужно быстро развертывать, поскольку он более экономичен и требует меньше технических знаний, в то время как вы должны обучать свой собственный LLM, если вам нужны знания, связанные с доменом, высокая конфиденциальность данных или индивидуальные рассуждения, которых не хватает существующим моделям.

Давайте посмотрим на таблицу сравнения, чтобы узнать, следует ли обучать свой собственный LLM или использовать существующий:

| Фактор | Поезд свой LLM | Использование LLM общего назначения |

| Потребность в кастомизации | высокий; нужно, чтобы он был адаптирован к конкретным данным и потребностям; | ограниченный; может работать с LLM общего назначения |

| Конфиденциальность данных | Полный контроль над конфиденциальными данными | Потенциальное воздействие на третьих лиц |

| Первоначальные затраты | Высокая из-за обучения и инфраструктуры | Более низкая первоначальная стоимость |

| Время развертывания | Более длительный срок; требует подготовки данных и обучения | Быстро; готов к использованию с API |

| Выступление | Оптимизирован для конкретных задач и доменов | Может не хватать точности для конкретной области |

| Масштабируемость | Нужна инфраструктура для масштабирования | Масштабируемость через облачных провайдеров |

| техническое обслуживание | Требует постоянного управления и обновлений | Управляемый поставщиками услуг |

| Продавец Lock-In | Избегать; полная собственность | Возможная зависимость от поставщика |

| Гибкость | Высокая; полный контроль и адаптивность | Ограниченные возможности настройки |

| Операционные расходы | Потенциально более низкие долгосрочные затраты | Плата за использование или абонентская плата |

Шаг за шагом процесс создания собственного LLM

Разработка большой языковой модели включает в себя несколько структурированных этапов, от определения цели и курирования наборов данных до обучения, развертывания и постоянного совершенствования. Ниже приведен пошаговый обзор, синтезирующий процесс для создания собственного LLM:

Шаг 1: Определите цели и стратегию

Прежде чем начать разработку большой языковой модели, уточните, что будет делать ваш LLM, кто будет использовать его и как вы будете измерять его успех.

Также рассмотрите тип решения, которое вы хотите создать; например, диалоговый помощник для внутренних групп поддержки, автоматический механизм суммирования для быстрого обзора документов или генератор кода для разработчиков.

Как только вы определите цель, установите измеряемые KPI на ранней стадии. Сосредоточьтесь на точности, задержке ответа, стоимости запроса и фактической надежности. Эти KPI помогут вам согласовать бизнес-цели с техническим направлением.

Затем выберите подход, который поможет вам построить свой собственный LLM. Вы можете выбрать один из следующих вариантов:

- Отладка существующего LLMМногие предприятия думают об этом, как о LLaMA, Mistral или Falcon, поскольку это наиболее экономичный, надежный и быстрый в обращении подход.

- Поезд с нуля Создавая свою собственную модель с нуля, используя массивные наборы данных и вычислительную инфраструктуру, она действительно предлагает полный контроль, но требует миллиардов токенов, мощных графических процессоров и месяцев экспериментов.

- Используйте систему на основе RAG, что позволяет объединить существующий LLM с векторной базой данных или хранилищем документов для обеспечения живых, фактических ответов, основанных на ваших собственных данных. Это идеальное среднее поле для организаций, которым нужна точность без переподготовки.

Шаг 2: Подготовьте и обработайте данные

Эффективность вашего LLM зависит от качества данных, которые вы предоставляете для обучения.

Таким образом, собирайте данные, имеющие отношение к делу, из нескольких надежных источников, таких как внутренние базы знаний, билеты на поддержку, руководства, исследовательские работы или веб-данные.

Опубликуйте эту чистую и предварительную обработку данных, удалив дубликаты, нерелевантные разделы и личную идентифицируемую информацию (PII). Затем нормализуйте форматирование, исправьте проблемы кодирования и стандартизируйте пунктуацию и интервал.

Вы также можете выбрать для Генерация синтетических данных Если вам не хватает определенных данных для обучения LLM.

Затем идет токенизация, которая включает в себя преобразование текста в числовые токены, которые может понять модель. Если вы тонко настраиваете LLM, то используйте токенизатор из вашей базовой модели для поддержания совместимости. Для моделей, обученных с нуля, создайте пользовательский токенизатор (BPE или SentencePiece).

Подумайте вот о чем:

- Для тонкой настройки обычно требуются десятки тысяч или несколько миллионов высококачественных образцов.

- Обучение с нуля может потребовать сотни миллиардов токенов и обширных вычислительных ресурсов.

Чем выше качество и более объективные данные, которые вы используете для обучения LLM, тем лучше и надежнее производительность, которую вы можете ожидать от своего LLM.

Шаг 3: Разработка моделей и обучение

Как только ваши данные будут готовы, перейдите к разработке модели. Начните с выбора архитектуры модели, например, хотите ли вы, чтобы ваш LLM был основан на:

- Архитектура на основе трансформатора (например, модели только для декодера, модели только для кодера или модели для кодера-декодера)

- Рекуррентные нейронные сети (RNN)

- Смесь экспертов (MoE)

- Mamba (Государственно-космические модели)

- Свёрточные нейронные сети (CNN)

Выбор архитектуры LLM должен полностью зависеть от вашего бюджета и предполагаемого масштаба.

Опубликуйте это и определите стратегию обучения из:

- Точная настройка, когда вы совершенствуете существующую модель, используя свой набор данных, чтобы специализировать ее для конкретного языка или задач.

- Настройка инструкций, где вы тренируете модель понимать и следовать инструкциям, подобным человеческим, делая ее более разговорной и контекстно-осознанной.

- Усиление обучения с помощью обратной связи человека или ИИ, где вы выравниваете модель с предпочтительным поведением, таким как полезность, фактичность или безопасность, используя петли обратной связи.

С данными, моделью и набором стратегий можно перейти к активному обучению, где:

- Вы будете использовать такие фреймворки, как PyTorch, Hugging Face Transformers, DeepSpeed или PEFT для настройки обучения и настройки гиперпараметров, таких как размер партии, скорость обучения, тип оптимизатора и накопление градиентов для стабильности.

- На протяжении всего обучения, постоянно проверять и оценивать результаты модели с использованием как автоматизированных показателей (потеря, недоумение, точность) и оценки человека для качества, фактической точности и обнаружения смещения.

Это гарантирует, что модель учится эффективно и соответствует намеченным результатам.

Шаг 4: Настройка и оптимизация LLM

После обучения выравнивайте тон и отзывчивость модели.

Настройте быстрое форматирование или весы инструкций или примените дополнительную контролируемую тонкую настройку для разговорного поведения.

Это гарантирует, что LLM соответствует тону бренда, рекомендациям по соблюдению и нюансам домена.

Человеческие петли обратной связи (через рейтинговые ответы) также могут со временем повысить качество продукции.

Не только это, но и то, что вы хотите сделать LLM эффективным для вывода. Вы можете сделать это, применяя такие методы, как:

- Квантирование: Уменьшает точность (например, 8-бит или 4-бит) для снижения задержки и использования памяти.

- Обрезка: Удаляет избыточные веса без значительной потери точности.

- Дистилляция: Передача знаний в более узкую и быструю модель.

Этот процесс гарантирует, что LLM развертывается в масштабе, обеспечивая при этом оперативность и экономичность.

Шаг 5: Развертывание и постоянное совершенствование

Далее настройте развертывание через безопасное API или микросервисы, интегрируя наблюдаемость, ограничения скорости и журналирование для отслеживания производительности в режиме реального времени.

Если для использования требуется контекстный, фактический ответ, интегрируйте слой RAG (Retrieval-Augmented Generation). Это соединяет модель с внешними базами знаний или векторными базами данных, позволяя ей ссылаться на живые или доменные данные.

Наконец, установите цикл обратной связи и мониторинга, который поможет вам отслеживать взаимодействие с пользователем, выявлять галлюцинации и периодически переобучаться с новыми или улучшенными данными.

На основе собранных данных периодически переобучайте свой LLM или настройте его на основе новых примеров. Эта постоянная оптимизация гарантирует, что ваш LLM остается в соответствии с бизнес-целями, развитием домена и ожиданиями пользователей.

Хотите построить свой собственный LLM? Вот почему вы должны выбрать инвентаризацию ума!

Создание LLM требует сочетания технических навыков в машинном обучении, глубоком обучении, обработке естественного языка и науке о данных. Наем экспертов в каждой из этих областей ИИ, поскольку ваша собственная команда может потребовать слишком много инвестиций.

В качестве лучшего решения мы в MindInventory. Мы объединяем опыт ИИ, инженерную точность и понимание доменов, чтобы помочь предприятиям проектировать, обучать и развертывать LLM, которые следуют их целям.

Если вы хотите настроить существующую модель фундамента, разработать собственный домен LLM или интегрировать RAG в контекст в реальном времени, наша команда предлагает решения для ИИ полного цикла.

Наши клиенты доверяют нам

- Консультативный подход, помогающий им глубоко выровнять Стратегия ИИ Для специфических потребностей домена.

- Мультимодальные возможности для интеграции текста, голоса, изображения и табличных данных для создания универсального решения LLM.

- Ускоренное время-к-значению мы приносим через многоразовые модули, синтетическую генерацию данных и многое другое, поддерживая быстрый оборот проекта.

- Опыт в области управления LLMOps и жизненным циклом, охватывающий автоматизацию, масштабирование, мониторинг и переподготовку, чтобы улучшить его с течением времени.

Выбор MindInventory дает вашему бизнесу доступ к экспертам в области доменов, разработке ИИ с полным стеком и партнерству для обеспечения того, чтобы ваш собственный LLM приносил ощутимое влияние и конкурентное преимущество.

Часто задаваемые вопросы

Построение индивидуального LLM с нуля может стоить от 100 000 до более 10 миллионов долларов, в зависимости от масштаба. Стоимость может варьироваться в зависимости от таких факторов, как масштаб и сложность проекта, подход к разработке, требования к данным, инфраструктура, опыт, количество персонала, которого вы нанимаете, интеграция и многие другие.

Время разработки пользовательского LLM занимает от нескольких месяцев (3-6) до года или более. Если вы дорабатываете существующую модель, это может занять до 3-6 месяцев. Если создание модели LLM с нуля, то это может занять год или более.

Да, вы можете настроить LLM с ограниченными данными, используя предварительно обученные модели через процесс, называемый обучением передаче, который более эффективен, чем обучение с нуля.

Отрасли, которые обрабатывают большие объемы данных и сложной информации, такие как здравоохранение, финансы и электронная коммерция, получают наибольшую выгоду от пользовательских LLM.

Чтобы гарантировать, что результаты Large Language Model (LLM) безопасны и беспристрастны, вы должны применять многоуровневый подход на протяжении всего жизненного цикла ИИ, точно настраивать его с обучением с подкреплением, использовать ограждения для фильтрации вредоносного контента и проводить строгие оценки со специализированными эталонами.

Единственный наиболее важный фактор, который улучшает производительность LLM, - это предоставление четких, хорошо структурированных подсказок ввода, часто называемых «быстрой инженерией».В то время как качество данных обучения и архитектура модели являются основополагающими, пользователи могут значительно повысить качество ответа LLM, направляя его конкретными инструкциями, контекстом и целями в своей подсказке.

Основным преимуществом использования больших языковых моделей (LLM) является повышение эффективности и производительности, поскольку они могут автоматизировать такие задачи, как анализ данных, создание контента и поддержка клиентов, освобождая человеческие команды для более сложной работы. LLM также могут улучшить опыт клиентов посредством персонализированной помощи и предоставить ценные, основанные на данных идеи из огромного количества информации.

LLM имеют широкие приложения, включая генерацию контента (маркетинговая копия, статьи), обслуживание клиентов (чат-боты, виртуальные помощники), перевод, разработку кода (поколение, отладка), анализ данных (анализ настроений, извлечение шаблонов), образование (репетиторство, персонализированное обучение), здравоохранение, финансы и кибербезопасность (обнаружение мошенничества).